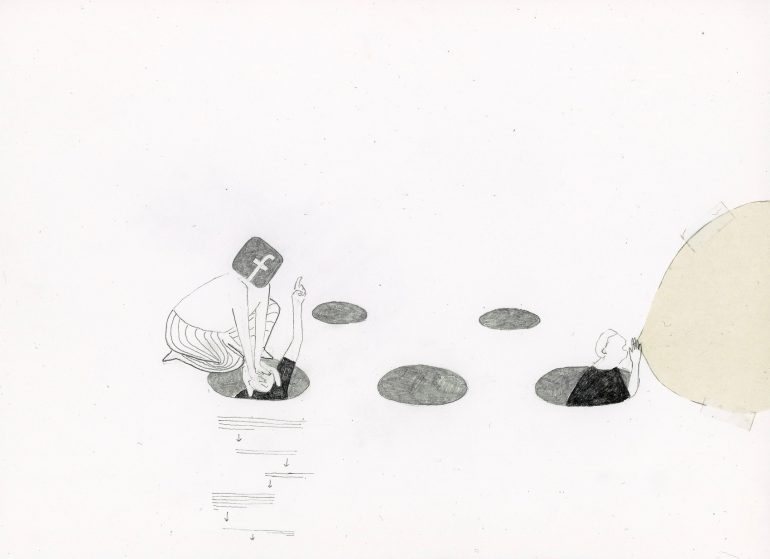

Het Frankenstein-monster van Facebook is los

Column – Oké, het kan dus. Iemand die Nazi-memorabilia wil promoten of kandidaten wil werven voor een extreemrechtse demonstratie, kan bij Facebook toegang kopen tot de newsfeeds van mensen die regelmatig gebruikmaken van woordcombinaties. Dat zijn combinaties zoals ‘Jew hater‘, ‘How to burn jews‘ of ‘Why jews ruin the world‘, ‘a Holocaust happened?’.

In ProPublica wordt beschreven hoe makkelijk het ging. Redacteuren betaalden dertig dollar om deze groepen te kunnen benaderen. Het duurde een kwartier voordat Facebook toestemming gaf. De redacteuren vertelden het Facebook en daarna werden de anti-Semitische categorieën verwijderd. Blijkbaar waren deze categorieën automatisch aangemaakt door een algoritme, niet door mensen.

Nog een keer deze zin:

Blijkbaar waren deze categorieën automatisch aangemaakt door een algoritme, niet door mensen.

Sorry, we kunnen er ook niets aan doen. Er zijn nu eenmaal mensen op Facebook die anti-Semitische teksten publiceren en deze teksten worden opgepikt door onze algoritmes. De ‘we’re just a platform‘-logica.

Bekrompenheid voorkomen

Opmerkelijk is het wel. Diezelfde algoritmes bleken in staat te zijn de klassieke foto van het Napalm-meisje van de Noorse nieuwssite van Aftenposten op te merken, omdat er te veel naakt in het beeld was. Facebook gaf overigens niet veel later haar kromme fout toe en liet de foto alsnog toe bij het artikel. En om in de toekomst een dergelijke bekrompenheid te voorkomen, is er waarschijnlijk de opdracht gegeven aan een programmeur om het algoritme dat naaktfoto’s moet herkennen aan te passen, en misschien iets meer context toe te laten.

Maar ga nu niet het verweer voeren dat algoritmes verantwoordelijk waren voor de anti-semitische categorieën die gebruikt kunnen worden om hakenkruizen en Mein Kampfen aan de man te brengen.

Niemand anders dan mensen verantwoordelijk

Mensen zijn verantwoordelijk, programmeurs van of werkend in opdracht van Facebook, en niemand anders. En zij hebben blijkbaar te veel vrijheid gelaten aan het automatisch genereren van doelgroepen. Zij hebben de ruimte gelaten voor het ontstaan van verzamelingen die aantrekkelijk zijn voor – laten we zeggen – slechte mensen. Racisten, liefhebbers van kinderporno, Jodenhaters, verkrachters, sigarettenfabrikanten, noem ze maar op.

Ander voorbeeld, ook van Facebook

Vorige maand werd bekend dat tijdens de presidentsverkiezingen van 2016 een serie van meer dan drieduizend advertenties met een waarde van honderdduizend dollar op Facebook werd gekocht door een Russische nepbron. Een trol die Facebookgebruikers tegenstrijdige berichten liet lezen over rechten van Afrikaanse Amerikanen, inclusief Black Lives Matter, en tegelijkertijd andere lezers duidelijk maakte dat deze groepen een toenemende bedreiging zijn voor de samenleving.

De Russische campagne zaaide ook tweespalt in religieuze groepen. Er waren ads die Hillary Clinton onder de aandacht bracht bij moslim-vrouwen. Alles wijst erop dat de trol goed geïnformeerd was en haarfijn aanvoelde hoe verdeeld de Amerikaanse bevolking was ten tijde van de Amerikaanse verkiezingen in 2016. Die verdeeldheid is er niet minder op geworden overigens.

Verwarring zaaien

Verwarring zaaien in het landschap, daar is het de Russische trol om te doen, net zoals dat het doel is van de terrorist. En de algoritmes van Facebook maken het mogelijk om heel gericht de minder-genuanceerden te bereiken en hen daarmee nog minder genuanceerd te maken.

Wired stelt het duidelijk: “Facebook beheerst haar algoritmes.” Buzzfeed twijfelt: “Mark Zuckerberg kan jou niet verhinderen om dit te lezen, omdat de algoritmes het al gewonnen hebben.” Twee artikelen, twee opvattingen.

Het was niet de bedoeling

Wired opent het artikel met de verwijzing naar de Russische trol die honderdduizend dollar lang haar gang kon gaan. Het Frankenstein-moment van Facebook, zoals dat ook wel in de New York Times werd genoemd. “We voorzagen het niet en het was ook nooit onze bedoeling dat deze functionaliteit op deze manier zou worden gebruikt”, zo verontschuldigde Sheryl Sandberg van Facebook zich. Het monster gaat zijn eigen gang, maakt zijn eigen categorieën en kan door iedereen in stelling worden gebracht.

Maar Facebook heeft in het verleden regelmatig bewezen de strijd tussen de aantrekkelijkheid van het platform en de in haar ogen ongewenste gebruikers succesvol te kunnen voeren. Het probleem was dat telkens als er een gat gedicht was er elders een andere mol naar boven kwam. Het wordt niet voor niets door een oud Facebook-medewerker het ‘Whack-a-Mole-spel’ genoemd, verwijzend naar het klassieke arcade-spel uit 1976.

We voorzagen het niet en het was ook nooit onze bedoeling dat deze functionaliteit op deze manier zou worden gebruikt.

Als het niet werkt, wordt het aangepast

Het Facebook-algoritme wordt voortdurend gekalibreerd om gebruikers het nieuws te brengen dat ze het meest waarschijnlijk ook echt zullen lezen. Als het niet werkt, wordt het algoritme aangepast. Iedere seconde. Met 1,3 miljard dagelijks actieve gebruikers is het onvoorstelbaar hoe snel er gereageerd kan worden.

De conclusie van Wired dat Facebook haar algoritmes beheerst, moet misschien genuanceerd worden. Facebook beheerst weliswaar haar algoritmes, maar het zijn de gebruikers die donders goed doorhebben hoe ze het spel kunnen spelen. De spelregels zijn domweg nog niet goed genoeg vastgesteld. En zo krijg je overal molletjes die hoopjes op het Facebook-gazon veroorzaken.

Buzzfeed is sceptischer. De critici kijken met argusogen naar de ontwikkeling van Alexa, Siri, Cortana en ook AlphaGo. Ze worden gezien als de voorbode van een dystopische toekomst waarin een regisserende rol voor Artificial Intelligence is weggelegd.

The lunatics will take over the hospital

Krijgt Poetin toch gelijk. In The Verge zegt hij dat het land dat de strijd om AI zal winnen, de heerser over de aarde zal zijn. En de Russen hebben bewezen het spel te kunnen spelen. Het doel van de spelers is om de nuance te verstikken, om overal waar redelijkheid de kop lijkt op te steken in te grijpen. Dat doe je door voor- en tegenstanders te voorzien van argumenten waardoor de middenweg een onbegaanbaar pad lijkt te worden. Het volk wordt digitaal, groepen zijn aan of uit, voor of tegen, en daar tussen wordt het niemandsland steeds groter.