Kwaliteit & ethiek van AI-video’s: een blik op de toekomst

Van het automatisch bewerken van beelden tot het genereren van realistische deepfakes: AI-videotools herdefiniëren hoe we video’s maken, bewerken en ervaren. Zo vooruitstrevend als deze ontwikkelingen lijken, brengen ze tegelijkertijd ook vragen met zich mee. Wat is de kwaliteit van AI-video’s? Hoe voorkom je misleidende inhoud? En hoe zit het met de authenticiteit? Ik geef antwoord én werp een blik op de toekomst van AI-videotools!

Kwaliteit AI-gegenereerde video’s

AI produceert in sommige gevallen redelijk overtuigende video’s. Vooral wanneer het model getraind is op specifieke taken. Zoals het genereren van menselijke gezichten of het aanvullen van ontbrekende frames in een video. Het genereren van volledig realistische video’s, die niet van echt te onderscheiden zijn, is nog steeds een uitdaging.

AI-modellen hebben vaak nog moeite om complexe visuele details en verfijnde aspecten correct weer te geven. En er kunnen opvallende en onnatuurlijke elementen in de gegenereerde video’s voorkomen. Zo zie je vaak nog weinig emotie bij de gegenereerde avatars. En hebben de voice-overs weinig variatie in stemgebruik en intonatie.

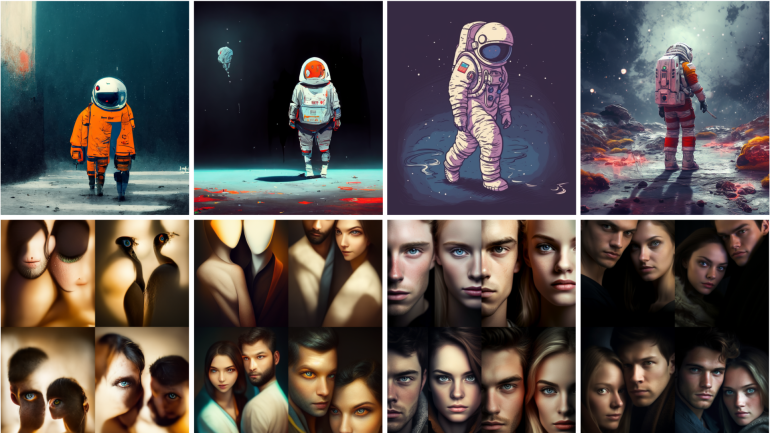

Op dit moment zijn AI-gegenereerde video’s nog makkelijk van echte beelden te onderscheiden. Maar als we kijken naar de ontwikkeling die Midjourney in een jaar heeft doorgemaakt (zie afbeelding hieronder), zien we een ontwikkeling die er wel eens voor kan zorgen dat we binnenkort al heel realistische video’s maken met AI.

AI-video: ethische disclaimer

Prompt: Deepfake of president Donald Trump getting arrested in front of the capitol, newsphotography, realistic, cops on the scene, realistic, — v 5.2

Hoewel AI-toolings soms te mooi lijken om waar te zijn, zit er helaas ook een ethisch mindere kant aan het genereren van AI-video’s. Zo kan deze technologie misbruikt worden voor het creëren van nepvideo’s. Of misleidende inhoud, ook wel bekend als deepfakes.

Dit brengt uitdagingen met zich mee op het gebied van betrouwbaarheid en authenticiteit van video-inhoud. Zo kunnen nieuwsberichten gemakkelijk gefaket worden en zijn echt en nep soms niet meer van elkaar te onderscheiden. De EU pleit in hun zogeheten AI-Act dan ook om altijd aan te geven wanneer iets is geproduceerd met behulp van AI.

Achter al deze AI zit een grote rekenkracht. Alleen al in januari 2023 gebruikte ChatGPT net zoveel energie als 175.000 huishoudens. Laat staan hoeveel rekenkracht er zit achter foto- of video AI-toolings. En daar bestaan inmiddels duizenden soorten van! Daarbij worden ook vaak mensen (tegen slecht betaald) aan het werk gezet om de AI-modellen te trainen.

Kortom, wees je bij het gebruik van AI-videotools altijd bewust van de ethische dilemma’s die erbij komen kijken en maak er geen misbruik van.

Hoe verhoudt AI-video zich tot authenticiteit?

Prompt: A hyper-realistic portrait with a person standing in a school, animations on screen, about school supplies, Modern, Realistic, chaos 100, Vibrant pallet, –ar 16:9 –s 250 –v 5.2

AI-gegenereerde video’s kunnen op het eerste gezicht zeer overtuigend en realistisch lijken. Echter, de mate van authenticiteit varieert en is afhankelijk van verschillende factoren.

Bij het ontwikkelen van AI-gegenereerde video’s is heel veel afhankelijk van toevalligheden die AI voor jou genereert. Zo bepaalt de tooling in de meeste gevallen zelf hoe de avatar eruitziet, hoe de voice-over gevormd wordt en hoe de exacte belichting van de video is. Hierbij komt de specialistische kennis en arbeid van de mens niet aan te pas. Tegenwoordig zijn er al wel steeds meer mogelijkheden om templates aan te passen naar eigen wens. Daar kan je enige creatieve controle op uit te voeren. Zo kan je een avatar creëren op basis van eigen foto’s. Of je stem laten klonen op basis van je eigen spraakopnames.

Toch heeft AI, zoals al eerder benoemd, nog niet altijd de mogelijkheid om verfijnde details door te voeren. Denk hierbij aan het aanpassen van de emoties van gegenereerde avatars. Of het spelen met het stemgebruik. Dit heeft te maken met het feit dat AI gegenereerde avatars niet de vaardigheden hebben om zich in te leven in hun onderwerp en het gevoel wat erbij komt kijken.

Om deze redenen voelen avatars soms onnatuurlijk aan, waardoor de echtheid en authenticiteit van het beeld deels verloren gaat. Het spontane, menselijke aspect mist, wat bijdraagt aan de betrouwbaarheid, geloofwaardigheid en daarmee de authenticiteit van de video.

Vooruitblik op AI-videotools

De verwachtingen voor video-AI in de toekomst zijn veelbelovend. Hoewel de mogelijkheid al bestaat om op basis van prompts video’s te genereren, heeft het nog wel een grote vertaalslag nodig.

De door Runway Gen-2 gegenereerde video’s bevatten vaak nog veel rare fouten, de clips kennen een beperkte videoduur en bevatten nog geen audio. Als je je bedenkt dat eerder in het jaar gebruikers met Gen-1 alleen nog op basis van foto’s of video’s nieuwe videocontent konden creëren, gaan de ontwikkelingen hard!

Zo bestaat er nu al de mogelijkheid om op basis van Midjourney gecreëerde afbeeldingen bewegende scènes te maken met Runway Gen-2. Wie weet dat we over een jaar op basis van spraak-naar-video tooling een volwaardige videocampagne kunnen opzetten. Zonder gebruik van echte acteurs, locaties, voice-overs en sfeerbeelden.

Met de huidige toolings genereer je al op basis van je eigen voorkeur geautomatiseerde video’s die passen bij jouw huisstijl. Het zou een mooie ontwikkeling zijn als de toolings op een gegeven moment zo geavanceerd zijn, dat ze jouw merk volledig herkennen. Denk aan een AI-videotool die voorspelt wat relevante onderwerpen zijn voor jouw doelgroep en dit meteen doorvertaald in video’s met de bijbehorende huisstijl.

De mens hoeft alleen nog maar een final check te doen. Uiteraard blijft de mens relevant voor het maken van verschil. Authenticiteit en onderscheidend vermogen worden steeds belangrijker. Dit kan niet zonder de mens. Zowel voor als achter de camera.

ChatGPT

ChatGPT